python多線程爬取文件,怎么設置超時重連。

問題描述

在用python爬取數據時,單進程里開啟多線程抓取,畢竟IO密集我就沒搞多進程了。

代碼如下

def get_downloads_url_list(self,pageNum):FilePath=’C:/RMDZY/h’+str(pageNum)os.chdir(FilePath)with open(FilePath+’/m3u8.txt’, ’r’) as f: m3u8_txt = f.read()download_ts_list = re.findall(r’ppvod’ + r’d{7}’ + r’.ts’, m3u8_txt)download_url_list = [url + str(pageNum) + ’/1000kb/hls/’ + download_ts_list[i] for i in range(len(download_ts_list))]max_length=len(download_url_list)dat_list=[’ts’+str(i)+’.ts’ for i in range(max_length)]dat_str=’+’.join(dat_list)ts_command=’copy /b ’+dat_str+’ new.ts’with open(’ts.bat’,’w’) as f: f.write(ts_command)return download_url_list def download_by_m3u8(self,i,pageNum):download_list=self.get_downloads_url_list(pageNum)ts_file = requests.get(download_list[i], verify=False)with open(’ts’+str(i)+’.ts’,’ab’) as f: f.write(ts_file.content)![圖片描述][1] def download_threading(self,pageNum):download_list=self.get_downloads_url_list(pageNum)thread_list=[]for i in range(len(download_list)): thread = threading.Thread(target=self.download_by_m3u8, args=[i,pageNum]) thread_list.append(thread) thread.start()for thread in thread_list: thread.join()

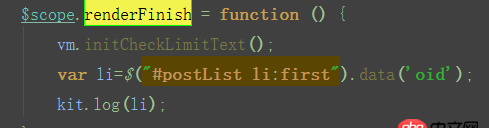

但是只要一個線程的requests沒有返回值,線程就會一直等待,也不會寫入,所以會出現,主進程一直沒阻塞的問題。如圖

請問怎么處理,比如,給requests.get設置一個timeout,但是超過之后怎么處理啊,我設置了timeout之后,好像線程直接被kill了,可以繼續下載下一個目標,但是,這個沒下載的我這么記錄啊,能不能捕獲這個異常然后重連啊。主要還是寫法,不太會。生疏啊

問題解答

回答1:num = 3 # 重試次數while num > 0: try:result = requests.get(..., timeout=3) except requests.exceptions.ReadTimeout:print ’Timeout, try again’num -= 1 else:# 成功獲取print ’ok’print resultbreakelse: # 3次都失敗 print ’Try 3 times, But all failed’

網公網安備

網公網安備